Google、ノートPCなどさまざまなデバイスで実行可能なオープンモデル「Gemma 3」を発表 何が特徴なのか:「単一のGPUやTPUで実行可能」「高いパフォーマンス」をうたう

Googleは、同社の「Gemini 2.0」モデルと同じ研究および技術に基づいて構築された軽量なオープンモデルのコレクション「Gemma 3」を発表した。

Googleは2025年3月12日(米国時間)、オープンなAI(人工知能)モデルファミリー「Gemma」の最新版となる「Gemma 3」を発表した。

Gemma 3は、Googleの「Gemini 2.0」モデルと同じ研究および技術に基づいて構築された、軽量で高性能なオープンモデルのコレクションだという。ノートPCからワークステーションまで、さまざまなデバイスで直接動作する。1B、4B、12B、27B(10億、40億、120億、270億)のサイズで提供され、ハードウェアとパフォーマンスのニーズに合わせて選択できる。

GPU/TPUで実行可能 Gemma 3の特徴

Gemma 3は以下の特徴を持っている。

単一のGPU/TPUで実行可能、高パフォーマンスを実現

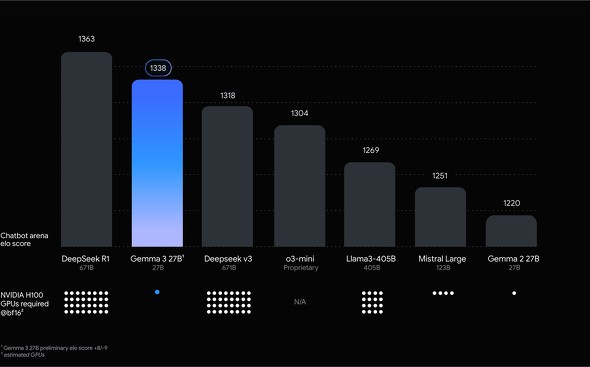

Gemma 3は、同クラスのモデルの中でも先端レベルのパフォーマンスを実現するという。LMArenaのリーダーボードにおける人間の選好による予備的評価では「Llama3-405B」「DeepSeek-V3」「o3-mini」を上回っている。「開発者は単一のGPU(Graphics Processing Unit)またはTPU(Tensor Processing Unit)を搭載するホストで優れたユーザー体験を提供できる」と、Googleは述べている。

140以上の言語に対応

35以上の言語をすぐに使える状態でサポートし、140以上の言語について、サポートするようトレーニングされている。グローバルなアプリケーション開発が可能だという。

高度なテキストおよび視覚的推論能力

テキストおよび画像の入力とテキストの出力に対応する(1Bモデルは画像入力に対応していない)。画像、テキスト、短い動画を分析するアプリケーションを簡単に構築できる。

拡張されたコンテキストウィンドウで複雑なタスクを処理

Gemma 3の12万8000トークンのコンテキストウィンドウにより、アプリケーションは大量の情報を処理して理解し、より高度な機能を実現できるという。

関数呼び出しによるAI駆動型ワークフローの作成

関数呼び出しと構造化出力をサポートし、タスクの自動化とエージェント体験の構築を支援する。

5つの量子化レベル(ビット深度)で目的のパフォーマンスを効率的に実現

Gemma 3では4つのパラメーターサイズのモデルを、5つの精度レベル(32bitの完全精度から、BF16〈16bit〉、SFP8〈8bit〉、Q4_0〈4bit〉、INT4〈4bit〉まで)で使用できる。これにより、機能と処理サイクル、メモリコスト、消費電力というトレードオフを調整し、要件に合わせてパラメーターサイズと精度レベルの組み合わせを選択し、目的のパフォーマンスを効率的に実現できる。

棒グラフは、各AIモデルを使用したチャットbotのパフォーマンススコア(Chatbot Arena Eloスコア)を示している。数値が大きいほどユーザーの評価が高い。棒グラフの下には各モデルのサイズが記載されている。一番下のドット数は、必要な「NVIDIA H100 GPU」の数を示す。Gemma 3 27Bは、同GPUを8個必要とする(提供:Google)

画像安全性チェッカー「ShieldGemma 2」

Googleは、Gemma 3を基盤として構築した強力な画像安全性チェッカーである「ShieldGemma 2」も発表した。ShieldGemma 2は、危険なコンテンツ、性的露骨表現、暴力の3つのカテゴリーで安全ラベルを出力する。開発者は安全性ニーズやユーザーに合わせてShieldGemmaをカスタマイズできる。

Gemma 3の使用と既存ツールとの統合

Gemma 3は、既存のワークフローにシームレスに統合できる。

- Hugging Face Transformers、Ollama、JAX、Keras、PyTorch、Google AI Edge、UnSloth、vLLM、Gemma.cppをサポートしており、プロジェクトに最適なツールを柔軟に選択できる

- 「Google AI Studio」でGemma 3を試すことができる。セットアップは不要だ。Google AI Studioから直接APIキーを取得し、「Google GenAI SDK」を通じてGemma 3を使用することもできる。KaggleやHugging FaceからGemma 3モデルをダウンロードすることも可能だ

- Gemma 3には、効率的なファインチューニングと推論のためのレシピを含む改良されたコードベースが付属している。Google Colab、Vertex AI、あるいはゲーム用GPUなど、好みのプラットフォームでモデルをトレーニングし、適応させることができる

- Gemma 3は、Vertex AI、Cloud Run、Google GenAI API、ローカル環境、その他のプラットフォームなど、さまざまなデプロイ(展開)オプションを提供する

- NVIDIAはGemma 3モデルを直接最適化し、同社のあらゆるサイズのGPUで最大限のパフォーマンスが得られるよう支援する

- Gemma 3は、Google Cloud TPUに最適化されており、オープンソースのROCmスタックを介してAMD GPUとも統合されている

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、ビジョン言語モデル「PaliGemma 2」を発表 化学式、楽譜、胸部X線など多様なタスクに対応

Google、ビジョン言語モデル「PaliGemma 2」を発表 化学式、楽譜、胸部X線など多様なタスクに対応

Googleは、同社のビジョン言語モデル「PaliGemma」の最新版となる「PaliGemma 2」を発表した。事前訓練済みのモデルおよびコードをHugging FaceやKaggleで閲覧、ダウンロードできる。 Google、2400億の検証可能な統計データを接続させたオープンLLM「DataGemma」を発表

Google、2400億の検証可能な統計データを接続させたオープンLLM「DataGemma」を発表

Googleは、大規模言語モデル(LLM)のハルシネーションの課題に対処するために、現実世界の統計データに接続するよう設計されたオープンLLM「DataGemma」を発表した。 Google、「Gemini 1.5 Pro」「Gemini 1.5 Flash」の新機能とオープンモデル「Gemma 2」を提供開始

Google、「Gemini 1.5 Pro」「Gemini 1.5 Flash」の新機能とオープンモデル「Gemma 2」を提供開始

Googleは、大規模言語モデル「Gemini 1.5 Pro」とGeminiファミリーの軽量モデル「Gemini 1.5 Flash」それぞれの新機能と最新オープンモデル「Gemma 2」を提供開始したと発表した。