VS Codeの新バージョンで「MCPの全機能をサポートした」とMicrosoftが発表:MCPにおける認証、プロンプト、リソース、サンプリングとは

Microsoftは2025年6月12日、「Visual Studio Code」の最新版「May 2025」(バージョン1.101)が、MCPの全機能をサポートしたと発表した。

Microsoftは2025年6月12日(米国時間)、同日公開した「Visual Studio Code」(以下、VS Code)の最新版「May 2025」(バージョン1.101)で、MCP(Model Context Protocol)の全機能をサポートしたことをブログで紹介した。

同年5月に公開されたバージョン1.100で、MCPのツールやワークスペースの認識機能などは導入されていたが、バージョン1.101では「認証」「プロンプト」「リソース」「サンプリング」などの機能が利用可能になった。Microsoftは「これでMCPの全機能に対応した」としている。

認証のサポート

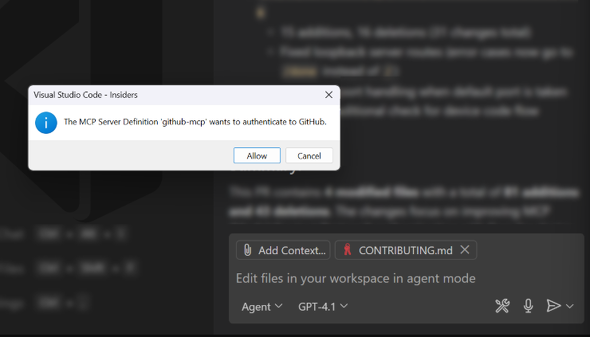

VS CodeがMCPの新しい認証の仕様に対応した。同社によると、この仕様の策定には、Microsoftの他、Anthropic、Okta(Auth0)、Stytch、Descopeを含む幅広いアイデンティティー(ID)コミュニティーが協力したという。

新しい認証では、MCPサーバを「リソースプロバイダー」として認証サーバから明確に分離した。そのため、開発者が独自の「OAuth」認証機能を一から構築する必要がなくなり、既存のIDプロバイダーに認証を任せられるようになった。

バージョン1.100で導入された「Streamable HTTPトランスポート」と組み合わせることで、エンタープライズレベルのセキュリティを維持しながら、独立して拡張可能なリモートMCPサーバを構築できるようになった。「GitHub MCP Server」がその一例だ。GitHub MCP Serverは、VS Codeの既存のGitHub認証とアカウント管理を利用し、OAuthを適切に統合したリモートサーバとして利用可能になっている。

プロンプトのサポート

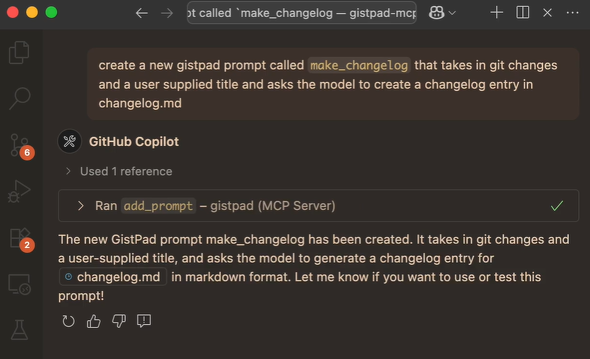

MCPは、LLM(大規模言語モデル)のアプリケーションやAI(人工知能)エージェントといったMCPクライアントに、MCPサーバがコンテキスト(文脈)、ツール、プロンプトを提供する仕組みになっている。

プロンプトは、LLMのために再利用可能なスニペットやタスクを生成するためにMCPサーバによって定義される。これは、ユーザーによって管理、調整できるように設計されている。

VS Codeのチャット内で「/mcp.servername.promptname」という形式のコマンドとしてアクセスでき、プレーンテキストを入力したり、プロンプト変数にコマンド出力を含めたりできる。

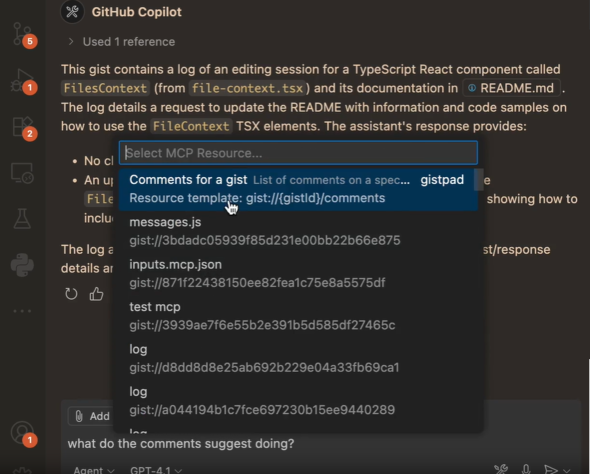

リソースのサポート

MCPにおけるリソースは、MCPサーバがエクスポーズ(公開)し、MCPクライアントによって読み取ることができるデータやコンテンツのことだ。テキストや画像などが含まれ、LLMが回答を生成する際のコンテキストとして利用される。

VS Codeでは、このリソースを表示したり保存したりできる他、コンテキストとして添付も可能だ。

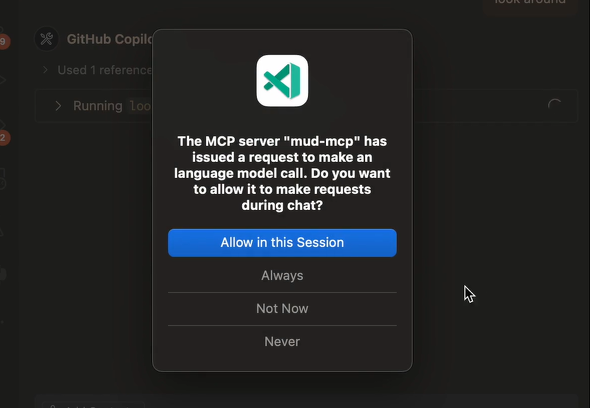

サンプリングのサポート(実験段階)

MCPにおけるサンプリングとは、MCPサーバがMCPクライアントを通じて、LLMにリクエストを送る機能だ。この機能を使うことで、セキュリティとプライバシーを維持しながら、複雑な推論をさせたりマルチエージェント同士の連携を促したりできる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Microsoftが「Visual Studio Code 1.100」を公開 GitHubリポジトリ横断検索やMCPサポートなど機能拡充

Microsoftが「Visual Studio Code 1.100」を公開 GitHubリポジトリ横断検索やMCPサポートなど機能拡充

Microsoftは、2025年5月8日「Visual Studio Code」の最新版「April 2025」(バージョン 1.100)を公開した。AIチャットの機能やパフォーマンスの強化をはじめ、さまざまな改良が加えられている。 VS Codeにもついに「持ち込みAI」時代が来た?──バージョン 1.99での変更点を紹介

VS Codeにもついに「持ち込みAI」時代が来た?──バージョン 1.99での変更点を紹介

Microsoftは2025年3月、「Visual Studio Code」の最新版「March 2025」(バージョン 1.99)を公開した。VS Codeの安定版で「エージェントモード」が利用可能になり、MCPサーバにも対応するなど、幾つかの変更点がある。 「Visual Studio Code」と「Ollama」で簡単に始められる、安心・安全なローカルAI活用術

「Visual Studio Code」と「Ollama」で簡単に始められる、安心・安全なローカルAI活用術

気軽に試せるラップトップ環境で、チャットbotを提供するオールインワンの生成AI環境構築から始め、Kubernetesを活用した本格的なGPUクラスタの構築やモデルのファインチューニングまで解説する本連載。今回は、「Visual Studio Code」と「Ollama」を活用し、Visual Studio Codeでローカルモデルに対してコードの生成や修正、レビューを指示したり、AIエージェントモードでコーディングさせたりする方法を解説します。