ChatGPTに「言っても良いことと悪いこと」を教えるツール NVIDIAがオープンソースコードで公開:話題の逸脱防止、正確な情報源、適切な連携を保証

NVIDIAは、ジェネレーティブAIの正確性や適切性、安全性の確保を支援するツール「NeMo Guardrails」をオープンソースで公開した。ジェネレーティブAIアプリケーションを指導し、軌道に乗った優れたテキストの応答を作成するのに役立つ。

NVIDIAは2023年4月25日(米国時間)、ジェネレーティブAI(生成系AI)の正確性や適切性、文脈の整合性、安全性の確保を支援するツール「NeMo Guardrails」をオープンソースで公開した。同社は「ソフトウェア開発者がジェネレーティブAIアプリケーションを指導し、軌道に乗った優れたテキストの応答を作成するのに役立つ」としている。

「全てのLLMで動作するようにした」

多くの産業で、これからのAIアプリケーションを支えるエンジンである大規模言語モデル(LLM)とそれを使ったサービスの採用が進んでいる。NeMo Guardrailsには、そういったテキスト生成型AIアプリケーションを安全に利用するために必要なコードやドキュメントがまとめられている。

NVIDIAは「OpenAIの『ChatGPT』をはじめとする全てのLLMで動作するように設計した」と説明している。数行のコードを追加するだけでルールを作成でき、機械学習やデータサイエンスの専門知識は不要だ。また、「LangChain」や「Zapier」をはじめ、多様なライブラリやツールと連携させることもできる。

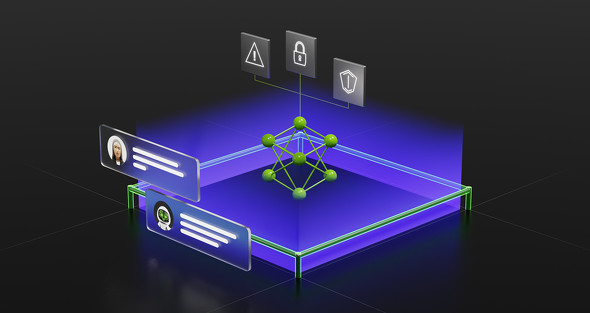

NVIDIAによると、NeMo Guardrailsを利用することで、AIアプリケーションに「3つのガードレール」を設定できるという。

話題のガードレール

AIアプリケーションが“望ましくない領域の話題”に逸脱するのを防ぐ。例えばカスタマーサービスが天気に関する質問に答えないようにする。

安全性ガードレール

アプリケーションが正確で適切な情報で応答することを保証する。不要な言葉をフィルタリングして、信頼できる情報源のみを参照するよう設定可能だ。

セキュリティガードレール

安全性が確認されている外部アプリケーションとのみ接続するように制限できる。

NeMo Guardrailsは、「NVIDIA NeMoフレームワーク」(以下、NeMoフレームワーク)に組み込まれている他、オープンソースコードとしてGitHubで公開されている。NeMoフレームワークの多くは以前からオープンソースコードで公開されており、ユーザーが独自のデータを使って言語モデルを学習させたりチューニングしたりできるようになっている。

また、同ツールはサービスとしても提供されている。生成AIモデル構築を支援するクラウドサービス群「NVIDIA Foundations」の一部として利用可能だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

「レガシーコードの解析」「単体テストの生成」はAIにお任せ KPMGがジェネレーティブAI活用に関する提言を発表

「レガシーコードの解析」「単体テストの生成」はAIにお任せ KPMGがジェネレーティブAI活用に関する提言を発表

KPMGは、ジェネレーティブAIに関する提言を発表した。それによると、ジェネレーティブAIを開発支援ツールとして採用しようとしている開発者は多く、「課題やリスクはあるものの今すぐにでも検証を開始すべきだ」としている。 生成系AI(GenAI、生成AI)とは?

生成系AI(GenAI、生成AI)とは?

用語「生成AI」について説明。全く新しいオリジナルのアウトプットを生み出すAI、具体的にはデジタルの画像や動画、オーディオ(音声/音楽など)、文章やコードなどのテキストを生成するAI、もしくはこれらを組み合わせて生成するAIのことを指す。 AIの“新しい波”は興奮と不安を生み出している MozillaがAIの透明性を確保するためのスタートアップを設立

AIの“新しい波”は興奮と不安を生み出している MozillaがAIの透明性を確保するためのスタートアップを設立

Mozillaは2023年3月22日(米国時間)、AI(人工知能)に特化したスタートアップ「Mozilla.ai」の設立を発表した。直近では「安全性と透明性の高いジェネレーティブAI」と「誤った情報を与えないレコメンドシステム」の開発を進めるという。